-

1 视频

-

2 章节测验

深度学习能够升级为通用人工智能吗

美国哲学家佛笃(Jerry Fodor)曾提出过一个论证,以否定人工神经元网络能够支撑起一个完整的人类认知架构。考虑到所谓的“完整的人类认知架构”与AGI之间的类似性,以及现有的深度学习机制对于传统的人工神经元网络的继承性,我们完全可以按照本文的语境要求,将佛笃的论证改造为一个对深度学习机制的“AGI化”进行质疑的论证。该论证如下:

大前提:任何一个AGI系统都需要能够处理那种“全局性性质”(globalproperties),比如在不同的理论体系之间进行抉择的能力(其根据则或许是“其中哪个理论更简洁”,或是“哪个理论对既有知识体系的扰动更小”,等等)。

小前提:深度学习系统所依赖的人工神经元网络,在原则上就无法处理“全局性性质”。

结论:深度学习机制自身就无法被“AGI化”。

此论证的大前提之所以是真的,乃是因为任何的AGI系统都必须具有人类水准的常识推理能力,而常识推理的一个基本特征,就是推理过程所会涉及到的领域乃是事先无法确定的。这也就是说,在涉及多样性的问题领域的时候,行为主体就必须具备对于来自不同领域的要求进行全局权衡能力,而这就是佛笃所说的处理“全局性质”的那种能力。不难想见的是,上述要求不仅是被施加给人类的,而且也是被施加给一个理想的AGI系统的——如果我们希望AGI具有人类水准上的通用问题求解能力的话。具体而言,家政机器人、聊天机器人与军用机器人所面临的环境的开放性与复杂性,都要求支持这些机器人运作的人工智能系统具有类似于人类的处理“全局性质”的能力。

深度学习机制是在原则上就难以处理这种具有领域开放性的全局性问题的。要说清楚这一点,我们必须用最简单的语言说清楚深度学习机制的基本运作原理。

Jerry Fodor

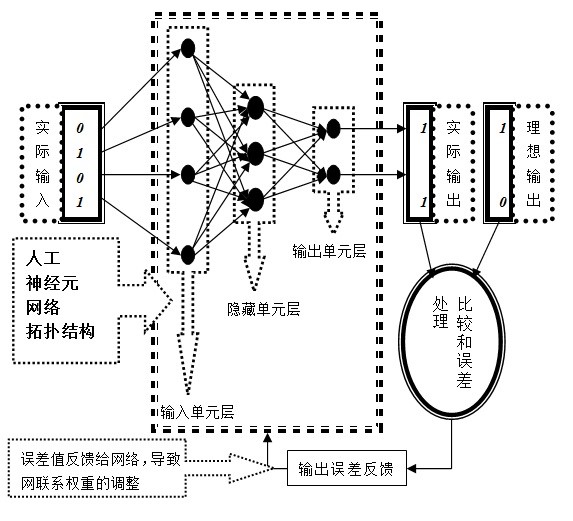

深度学习机制的前身乃是人工神经元网络,人工神经元网络技术的实质,就是利用统计学的方法,在某个层面模拟人脑神经元网络的工作方式,设置多层彼此勾联成网络的计算单位(如输入层—隐藏单元层—输出层等)。由此,全网便可以以类似于“自然神经元间电脉冲传递,导致后续神经元触发”的方式,逐层对输入材料进行信息加工,最终输出某种带有更高层面的语义属性的计算结果。至于这样的计算结果是否符合人类用户的需要,则取决于人类编程员如何用训练样本去调整既有网络各个计算单位之间的权重(参图—1)。

图—1 一个被高度简化的人工神经元网络结构模型

一般而言,隐藏层计算单元只要受过适当的训练,就能够初步将输入层计算单元递送而来的“材料”归类为某个较为抽象的范畴,而所有的这些抽象范畴之间的语义关系,则可以通过某种记录隐藏层计算单元之触发模式的所谓“矢量空间”,而得到一种立体几何学的表征。至于作为人工神经元网络之升级版的“深度学习”,其与自己的前身之间的区别则主要在于两个方面:(甲)其隐藏计算单元层的层次更多(因此可以通过更为复杂的概念层级来处理材料);(乙)系统的反馈学习算法一般会比传统人工神经元网更为复杂。这两个特征,一方面固然使得深度学习机制比传统人工神经元网络具备了更强的数据处理能力,但在另一方面也使得其运作需要更多的训练材料与更强大的计算机硬件来加以支持。

而从佛笃哲学的立场上看,深度学习技术相对于传统神经元网络的这种进步,只具有有限的工程学意义,而缺乏重大的哲学意义。这是因为:深度学习机制也好,传统的神经元网络也罢,它们全都缺乏跨领域的学习能力。